随着人工智能技术的飞速发展,大型语言模型(LLM)已成为行业应用的核心驱动力。在系统集成服务中,合理选择和应用架构模式是确保大模型高效、可靠部署的关键。以下是10种常见的大模型应用架构模式及其在人工智能行业应用系统集成服务中的价值。

- 单体架构模式:将大模型与业务逻辑集成于单一应用中,适用于小规模、低复杂度场景,如智能客服系统。系统集成服务可通过快速部署和简化维护帮助客户降低初始成本。

- 微服务架构模式:将大模型功能拆分为独立服务,例如自然语言处理(NLP)微服务。在行业应用中,集成服务商可通过模块化设计提高系统的可扩展性和容错性,适用于金融风控或医疗诊断平台。

- 分层架构模式:将系统划分为表示层、业务逻辑层和数据层,大模型通常位于业务逻辑层。集成服务利用此模式实现清晰的职责分离,便于在智能制造或教育系统中集成AI能力。

- 事件驱动架构模式:通过事件流触发大模型推理,例如实时数据分析或物联网(IoT)应用。系统集成服务可借助消息队列(如Kafka)确保高吞吐量和低延迟,适用于智慧城市或自动驾驶场景。

- 管道架构模式:将大模型任务组织为线性处理管道,如数据预处理、模型推理和后处理。在行业应用中,集成服务商可优化管道性能,用于内容生成或自动化报告系统。

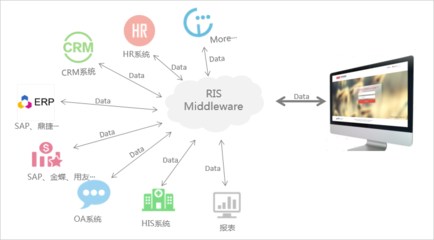

- 混合架构模式:结合多种架构优势,例如微服务与事件驱动的融合。系统集成服务通过定制化设计满足复杂需求,如企业级知识管理或个性化推荐平台。

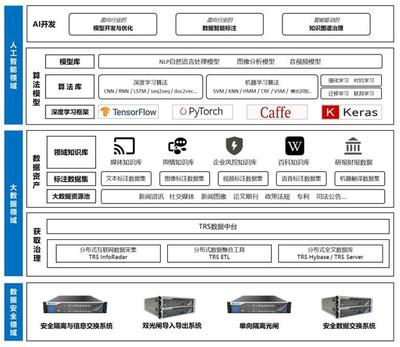

- 联邦学习架构模式:在分布式环境中训练大模型,同时保护数据隐私。集成服务在医疗或金融行业应用此模式,确保合规性并提升模型泛化能力。

- 边缘计算架构模式:将大模型部署于边缘设备,减少云端依赖。系统集成服务支持低延迟应用,如工业自动化或远程监控,提高实时响应能力。

- Serverless架构模式:基于云函数触发大模型推理,实现按需伸缩。集成服务商利用此模式降低成本,适用于突发性任务,如社交媒体分析或客户支持系统。

- 容器化架构模式:使用Docker或Kubernetes封装大模型及其依赖。系统集成服务通过容器化确保环境一致性,简化部署和维护,适用于多租户SaaS平台或跨部门协作系统。

在人工智能行业应用系统集成服务中,这些架构模式的选择需结合具体业务场景、性能要求和成本约束。通过专业集成,企业能高效利用大模型能力,推动数字化转型与创新。